执行摘要

Google TPU v8 标志着 AI 加速器设计的实际转变:训练和推理不再被视为相同的硬件问题。 v8 系列将高吞吐量训练系统与推理优化系统分开,因此每个系统都可以围绕其实际工作负载调整内存带宽、互连行为、同步、热设计和成本结构。对于 OEM、EMS、云基础设施和采购团队来说,信息很明确:人工智能计算采购正在从逐个芯片的比较转向系统级架构评估。

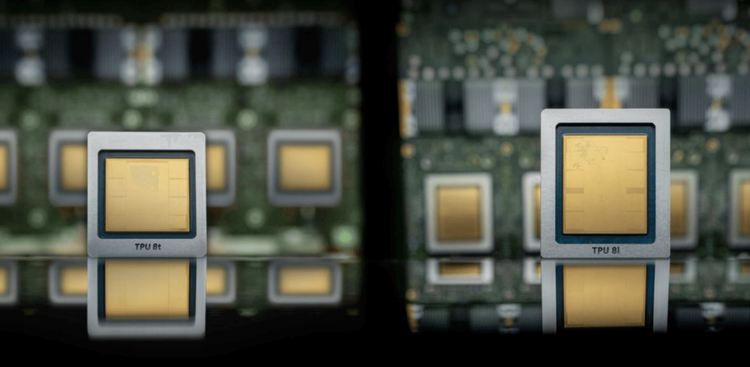

架构概览

TPU v8 一代通常通过两个互补的方向进行讨论。 TPU 8t 针对大规模训练,其中密集计算、内存带宽和集群规模通信决定训练时间和利用率。 TPU 8i 针对推理、采样和服务工作负载,其中延迟、批量灵活性、模型路由和能源效率通常比峰值训练吞吐量更重要。这种分离反映了现代人工智能系统的现实,特别是专家混合模型、长上下文推理模型以及在内存、网络和计算资源之间不规则移动的代理工作负载。

关键趋势

一个主要趋势是拓扑的重要性不断上升。人工智能基础设施的性能越来越依赖于加速器在机架内、跨 Pod 以及内存池之间的通信方式。另一个趋势是特定于工作负载的芯片和电路板设计。训练集群受益于最大聚合吞吐量和高速集体操作,而推理集群通常需要更低的延迟、在可变批量大小下更好的利用率以及可预测的功耗。第三个趋势是软件硬件协同设计。当编译器和服务框架可以将专内存引擎、集体加速和数据编排等功能清晰地暴露给模型开发人员时,它们就会变得更有价值。

市场分析

AI 加速器市场不再仅由 GPU 替代品或原始 TOPS 比较来定义。超大规模企业、模型公司和企业人工智能平台正在评估加速器价格、网络、内存配置、机架电源、冷却、软件迁移和供应连续性等方面的总拥有成本。 TPU v8 加强了谷歌的内部人工智能基础设施战略,也向更广泛的半导体市场发出信号:推理效率将成为决定性的战场。由于模型部署的扩展速度比前沿模型训练更快,因此与单独的训练硬件相比,以推理为中心的硬件可能会成为更大的采购和容量规划问题。

供应链影响

对于采购团队来说,TPU v8 强化了评估完整系统物料清单的需求。内存选择、光学或电气互连、电源模块、冷却组件、基板、先进封装和板级可靠性都会影响部署风险。面向训练和面向推理的集群可能需要不同的资格路径、备件规划和供应商风险模型。 EMS 团队应该准备更专业的服务器配置,而不是单一的通用人工智能加速器平台。

建议

工程和采购团队应在选择硬件之前按工作负载类型对人工智能基础设施需求进行分类。训练、微调、检索、实时推理、批量推理和代理执行可能存在不同的瓶颈。团队应尽早对电源和冷却进行建模,验证内存和互连可用性,并比较系统级 TCO,而不仅仅是加速器单位成本。在制定长期容量计划时,维护电源、散热、连接器、光学模块和内存组件的合格替代品也很有用,因为这些支持类别可能成为人工智能基础设施扩展期间的限制因素。

结论

谷歌 TPU v8 表明,人工智能硬件竞争的下一阶段是平衡基础设施,而不仅仅是峰值计算。获胜的平台将把芯片、内存、互连、软件和供应链执行结合到系统中,这些系统对于它们所服务的确切工作负载来说是高效的。对于 OEM 和 EMS 团队来说,这使得早期架构规划和组件级采购策略比以往任何时候都更加重要。